Europees AI-beleid: dit moet je weten over de AI-Act

De EU wil met de AI-Act een wettelijk kader creëren voor de ontwikkeling, inzet en het gebruik van kunstmatige intelligentie. Er gelden strengere regels voor systemen met een hoger risico voor veiligheid en rechten van mensen.

De belangrijkste doelen van de AI-Act zijn:

1. Risicobenadering

AI-systemen worden ingedeeld in vier risiconiveaus.

- Onaanvaardbaar

- Hoog

- Beperkt

- Minimaal

2. Bescherming van rechten

De wetgeving beschermt burgers tegen negatieve effecten van AI, zoals discriminatie en privacy.

3. Vertrouwen en transparantie

Er worden eisen gesteld aan transparantie en uitlegbaarheid van AI-systemen om het vertrouwen in AI te vergroten.

4. Innovatie bevorderen

Hoewel de AI-verordening strikte regels oplegt, probeert het ook een kader te bieden waarin innovatie kan floreren. Dit gebeurt door een evenwicht te zoeken tussen regulering en de vrijheid voor bedrijven.

5. Harmonisatie binnen de EU

Door geharmoniseerde regels te creëren, voorkomt de AI-Act verschillende nationale regels en versterkt het de concurrentiekracht van de EU op AI-gebied.

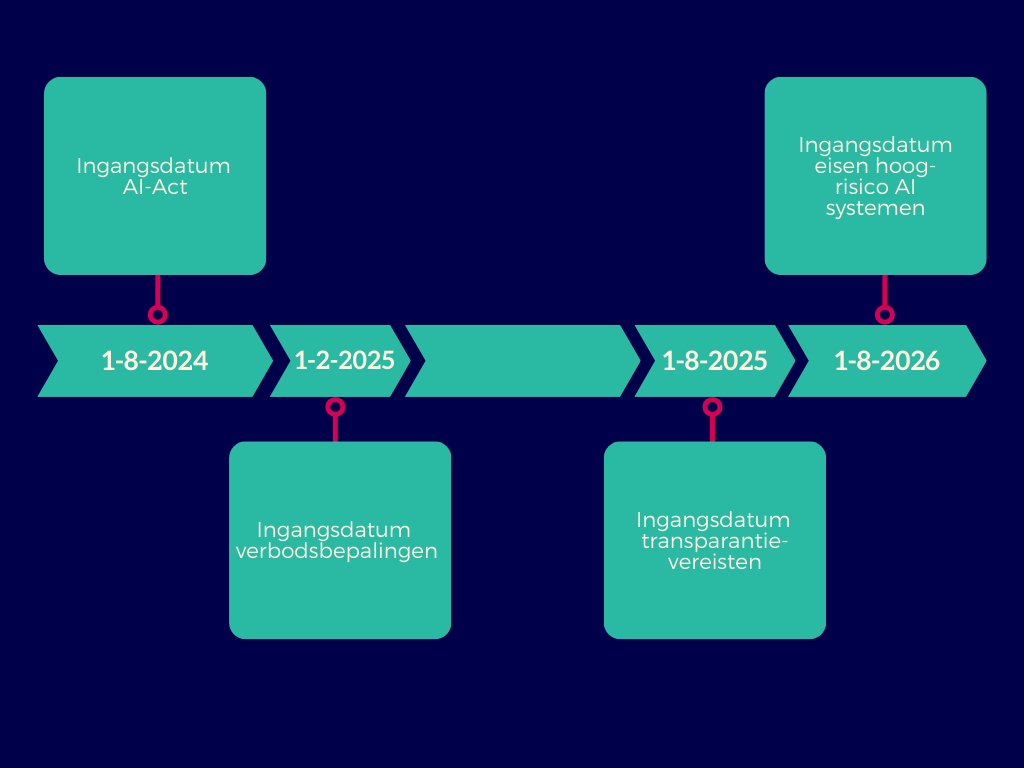

De AI-act gaat in stappen in en zal medio 2027 voor het grootste deel van toepassing zijn. Een aantal AI-systemen zijn vanaf februari 2025 al verboden. Daarom is het slim om je nu alvast voor te bereiden.

Wat betekent de AI-Act voor jouw uitzendonderneming?

Afhankelijk van het AI-systeem en wat je met dat systeem doet, gaan er eisen gelden voor de ontwikkeling en het gebruik van dit systeem. Of er eisen gaan gelden, is onder andere afhankelijk van het risico dat het AI-systeem heeft voor veiligheid, gezondheid en fundamentele rechten. Ook worden er andere eisen gesteld aan ondernemingen die AI (laten) ontwikkelen (aanbieder), dan aan ondernemingen die AI gebruiken (gebruikersverantwoordelijke).

Alle AI-systemen vallen onder de AI-verordening, maar er worden verschillende eisen gesteld aan verschillende categorieën, gebaseerd op het risico. Dit risico wordt bepaald door de beoogde toepassing waarvoor het AI-systeem wordt ontwikkeld en gebruikt:

- Verboden AI: deze AI-systemen mogen niet verkocht, gebruikt of in gebruik gesteld worden. De ingangsdatum van de verbodsbepalingen is 1-2-2025. Meer informatie over de verbodsbepalingen volgt volgende week in ABU nieuws.

- Hoog-risico AI: deze AI-systemen moeten aan verschillende eisen voldoen om risico’s te beperken voordat ze mogen worden verkocht of gebruikt.

De AI-Act beschouwt AI-systemen die worden gebruikt in de werkgelegenheid als hoog risico. Dit komt doordat deze systemen aanzienlijke negatieve effecten kunnen hebben op de grondrechten van mensen. Voorbeelden van hoog-risico AI-toepassingen in de uitzendbranche zijn:

- Personeelsbeheer en toegang tot werk

- Werving en selectie van kandidaten

- Beslissingen over arbeidsvoorwaarden

- Promotie en beëindiging van arbeidscontracten

- Toewijzing van taken op basis van gedrag of persoonlijke kenmerken

- Monitoring en evaluatie van werknemers

Omdat deze AI-systemen grote invloed kunnen hebben op iemands carrière en levensonderhoud, worden ze streng gereguleerd om de rechten en veiligheid van werknemers te beschermen.

De ingangsdatum van de eisen voor hoog risico AI systemen is 1-8-2026. Dat lijkt nog ver weg maar gezien het grote aantal eisen is het goed om je hier nu vast in te verdiepen.

Tijdlijn